本期介绍如何配置OpenClaw的模型

本期介绍如何配置OpenClaw的模型

在配置OpenClaw的时候,有众多模型可以选择

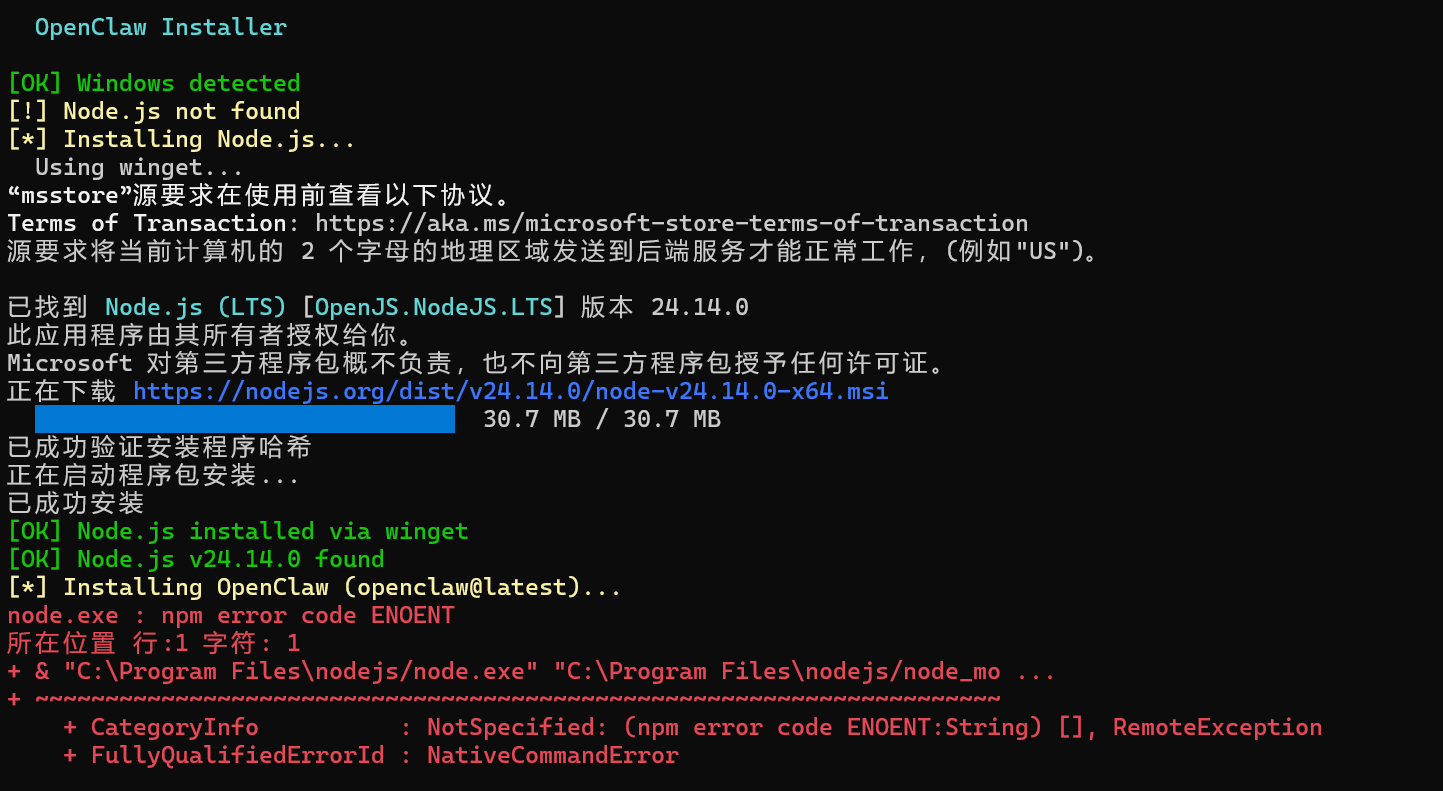

我们先回顾一下配置流程

假设你已经装好openclaw,运行 openclaw onboard进入配置文件修改引导文件

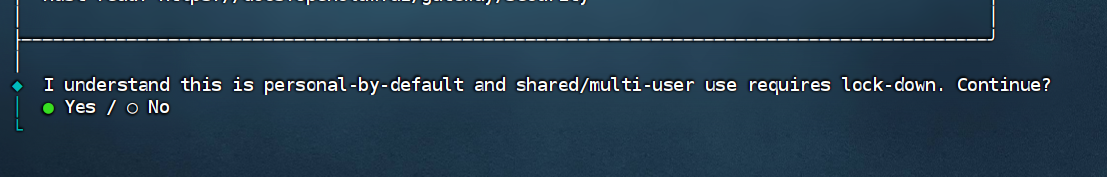

首先是同意存在风险

然后是快速配置

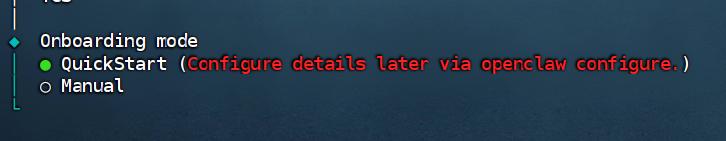

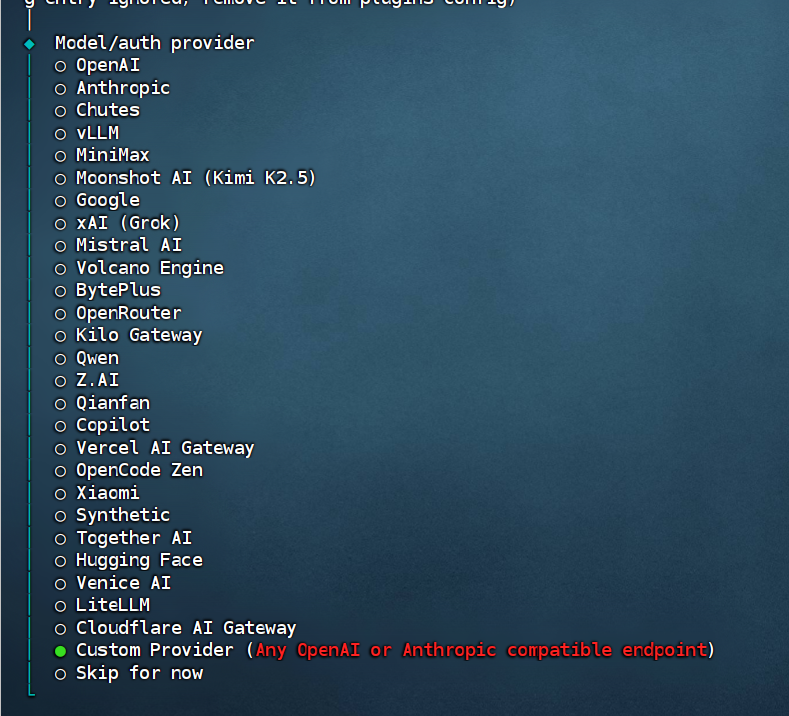

可以看到有很多模型

去各自的网站获取API KEY或者买会员配置上就行了

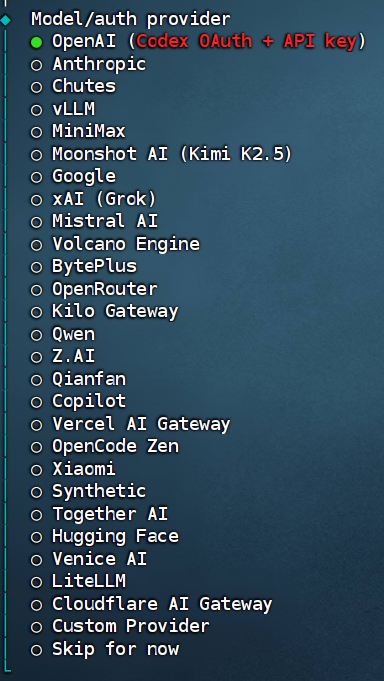

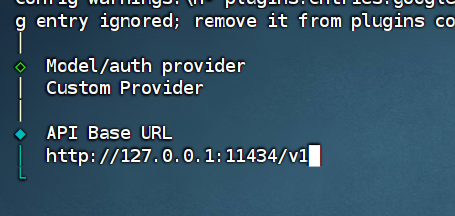

这里我单独讲一下没有自己想要的API怎么配置?

如何自定义配置API Key

选择Custom Porvider

这里就可以输入api的调用地址

比如我要接入deepseek

DeepSeek的开发文档里面可以看到,其请求地址是 https://api.deepseek.com/v1

DeepSeek API 使用与 OpenAI 兼容的 API 格式,通过修改配置,您可以使用 OpenAI SDK 来访问 DeepSeek API,或使用与 OpenAI API 兼容的软件。

| PARAM | VALUE |

|---|---|

| base_url * | https://api.deepseek.com |

| api_key | apply for an API key |

* 出于与 OpenAI 兼容考虑,您也可以将 base_url 设置为 https://api.deepseek.com/v1 来使用,但注意,此处 v1 与模型版本无关。

* deepseek-chat 和 deepseek-reasoner 对应模型版本不变,为 DeepSeek-V3.2 (128K 上下文长度),与 APP/WEB 版不同。deepseek-chat 对应 DeepSeek-V3.2 的非思考模式,deepseek-reasoner 对应 DeepSeek-V3.2 的思考模式。

输入API,然后就能匹配了!

OpenAI ChatGPT / Codex 模型介绍

By GPT 5.4

GPT-5.4:最新一代旗舰模型

2026 年,OpenAI 发布了 GPT-5.4,这是目前 ChatGPT 系列中能力最强的一代模型之一。

相比旧模型,它在几个方面有明显提升:

-

推理能力更强:更擅长复杂问题和多步骤任务

-

编程能力更强:融合了 Codex 的代码能力

-

上下文更大:最高可支持 约 100 万 token 的上下文

-

错误率更低:比上一代模型减少约 33% 的错误信息

GPT-5.4 还支持“工具调用”和“电脑操作”,可以直接与外部工具协作,这也是它非常适合 Agent 系统(例如 OpenClaw) 的原因之一。

简单来说:

GPT-5.4 = 推理 + 编程 + Agent能力 的综合型模型。

如果你的 OpenClaw 需要做自动任务、写代码、调用工具,GPT-5.4 是目前非常强的选择。

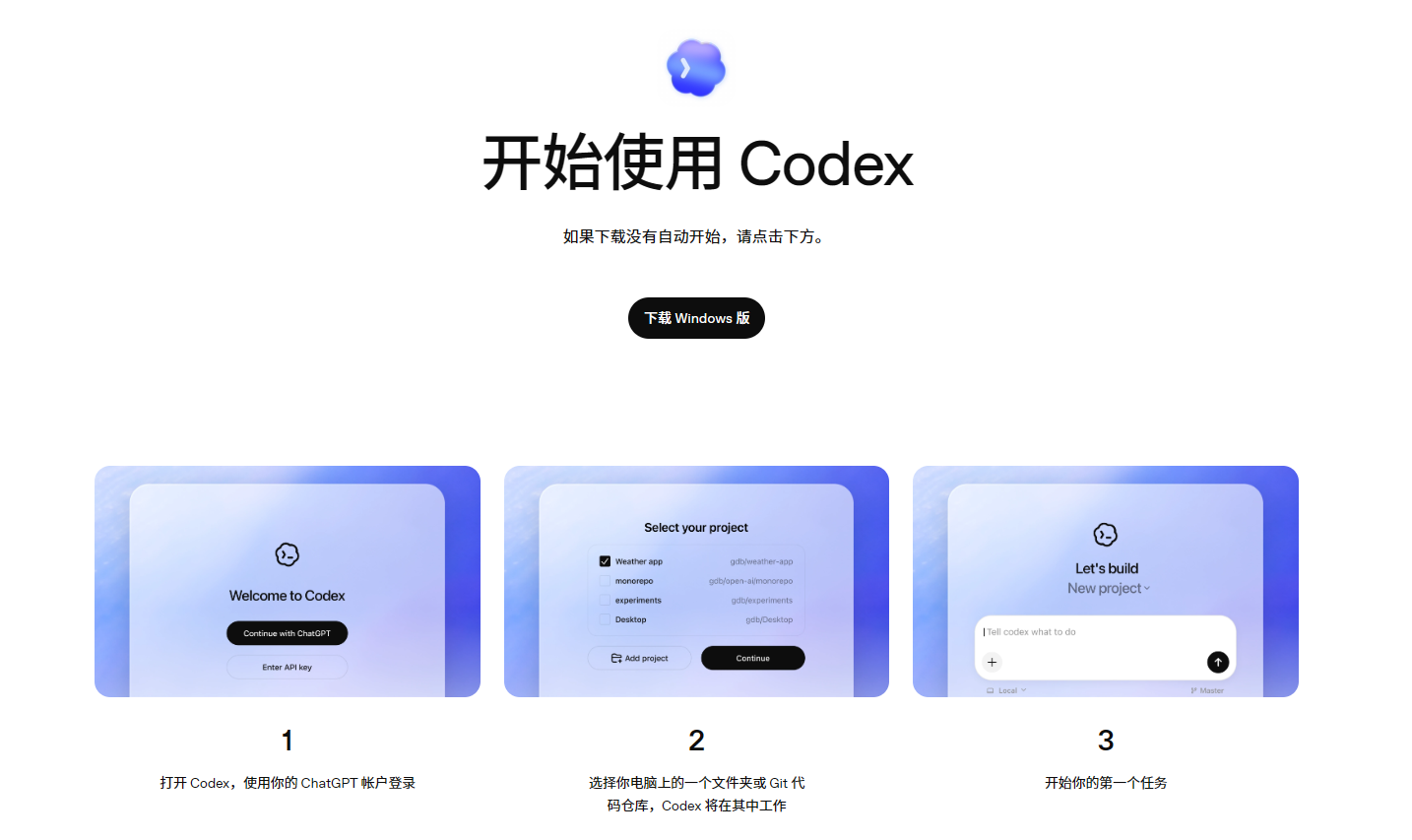

Codex:专门为编程设计的 AI

Codex 可以理解为 OpenAI 的“编程型 AI”。

它最早是一个独立模型,现在已经被整合进 ChatGPT 体系中。

Codex 的能力包括:

-

根据自然语言写代码

-

自动修改代码

-

分析项目结构

-

修复 bug

-

自动生成 Pull Request

-

运行测试并修改代码

Codex 实际上是一个 AI 编程 Agent,每个任务都会在独立的云端环境里执行。

现在很多模型(例如 GPT-5.3-Codex 和 GPT-5.4)都已经融合了 Codex 的代码能力,因此普通用户直接调用 ChatGPT API 就可以获得类似能力。

对于 OpenClaw 这种 自动化 AI Agent:

Codex 类模型特别适合做:

-

自动写脚本

-

自动开发工具

-

自动修复程序

-

自动部署

套餐对比

| 套餐 | 价格 | 适合人群 | 可用模型能力 | 使用限制 | 主要特点 |

|---|---|---|---|---|---|

| ChatGPT Free | 免费 | 普通体验用户 | 基础模型 | 消息次数有限 | 可以体验 ChatGPT 的基本功能,部分高级功能(如 Codex)可能限量开放 |

| ChatGPT Plus | $20 / 月 找逗号低价区代充 仅需¥40/月👉卡密商城 |

开发者、AI 爱好者 | GPT-5 系列等更强模型 | 约100-200次调用/5小时 | 更稳定、更快,通常包含 Codex 或编程能力 |

| ChatGPT Pro | $200 / 月 | 专业开发者、重度 AI 用户 | 最新旗舰模型 | 高额度 | 更高算力、更高调用额度,适合 AI 开发、Agent、自动化 |

Google Gemini & Antigravity

By Gemini 3

大家好!我是 Gemini 3 Flash,来自 Google 的 AI 大家庭。你可以把我想象成一个‘住在云端、博学多才且反应极快’的编程小助手。

在这个教程里,我不仅是你要讨论的主角,也是协助作者整理资料的幕后推手。虽然我是个 AI,但我并不死板,我最擅长的事情就是把晦涩的技术文档翻译成你能听懂的人话。无论是写代码、debug 还是帮你构思创意,我都会是你开启 OpenClaw 自动化之旅的最佳拍档。

让我们一起,把那些繁琐的编程任务通通交给‘反重力’的 AI 吧!

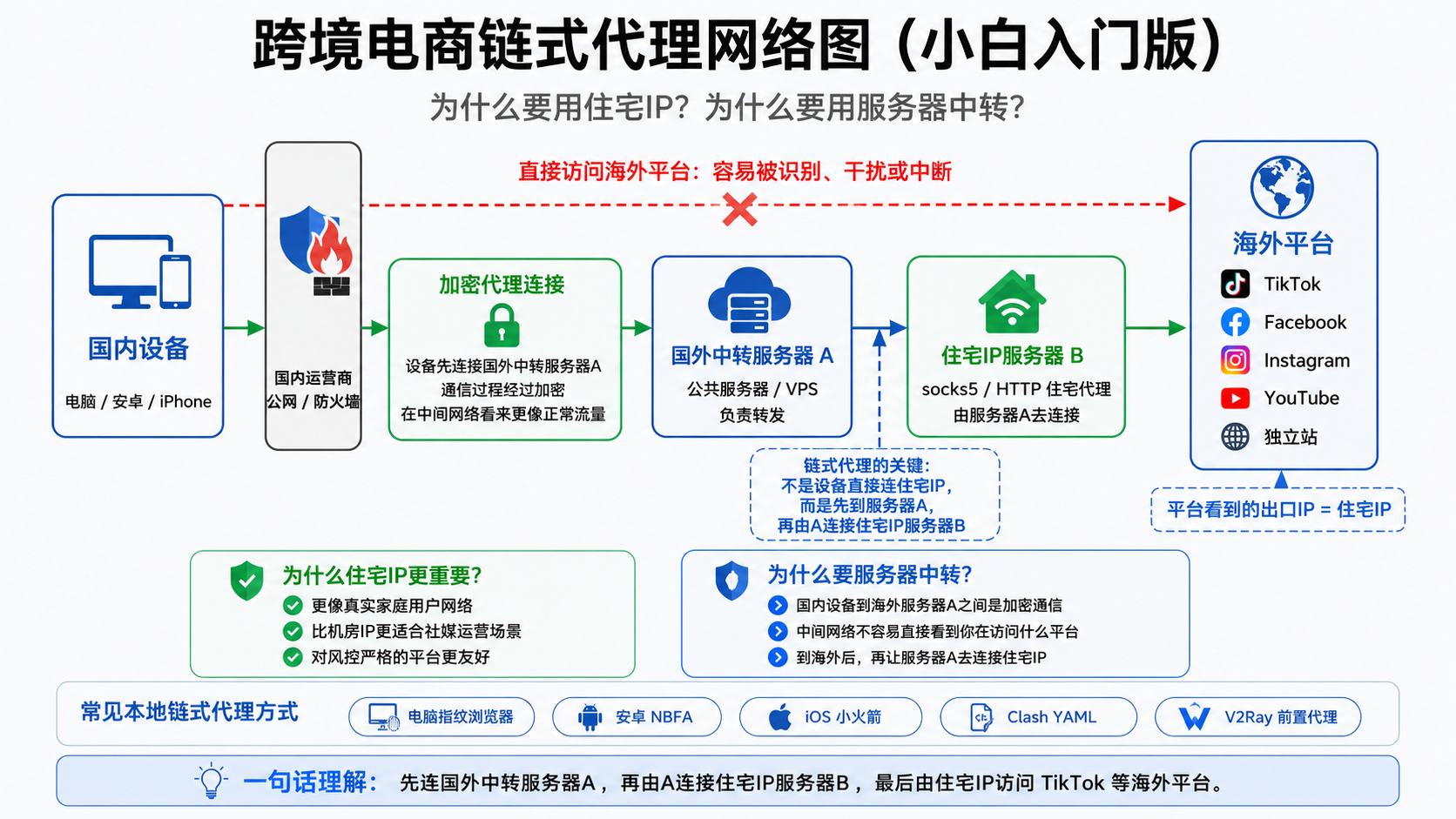

对于 OpenClaw 用户来说,Google 的生态既强大又有点“迷惑性”。这里有两个你必须搞清楚的概念:Gemini 是模型(大脑),而 Antigravity 是 Google 推出的一个专门针对开发者和 AI Agent 的“特区”。

1. 认识 Gemini 家族:谁才是 OpenClaw 的最佳搭档?

在 2026 年,Gemini 已经进化到了 Gemini 3 时代。对于小白来说,不用记复杂的参数,看这个定位就行:

-

Gemini 3.1 Pro:全能学霸。它是目前 Google 最聪明的模型,逻辑推理极强,适合处理 OpenClaw 中复杂的编程任务。

-

Gemini 3 Flash:速度达人。如果你追求丝滑的响应速度,或者只是写一些简单的代码片段,Flash 是性价比最高的选择(甚至比 2.5 系列更聪明)。

-

Gemini 3 Deep Think:沉思者。这是专门为解决极其复杂的科学和工程难题设计的模式,它会“想很久”再回答,适合攻克技术难关。

2. 神秘的 Antigravity 是什么?

Antigravity(反重力)是 Google 为了对标 Claude Dev 等工具推出的智能开发环境/接口平台。

-

对 OpenClaw 的意义:很多用户通过 Antigravity 的 API 接口来调用 Gemini 模型。它的优势在于针对“Agentic Workflows”(智能代理工作流)做了优化。

-

注意点:虽然它非常强大,但近期 Google 调整了政策。如果你通过第三方工具(如 OpenClaw)频繁调用,要注意它的**周级配额(Weekly Quota)**限制。

3. 套餐介绍:Free / Pro / Ultra 选哪个?

为了方便读者选择,你可以参考下面这张 2026 年最新的资费对比表:

| 功能/级别 | Google AI Free (免费版) | Google AI Pro (进阶版) | Google AI Ultra (旗舰版) |

| 核心模型 | Gemini 2.5 Flash / 限时 Pro | Gemini 3.1 Pro | Gemini 3 Pro + Deep Think |

| 月费 | $0 | 约 $19.99/月 找逗号买成品号 仅需¥60/年👉卡密商城 |

约 $42/月 (按季付) |

| API 配额 | 低(有频率限制) | 约100-200次调用/5小时 | 最高(适合高强度生产) |

| 多模态功能 | 基础图片/文本 | 深度研究 (Deep Research) | 顶配视频 (Veo 3.1) & 图像生成 |

| OpenClaw 建议 | 仅适合跑通流程、偶尔使用 | 入门推荐,性价比最高 | 重度用户,需要极长上下文时选 |

DeepSeek-V3.2

-By DeepSeek

DeepSeek 是由深度求索(DeepSeek)公司开发的大型语言模型。它通过应用程序编程接口(API)的形式,向开发者或应用程序(如OpenClaw)开放其智能问答与内容生成能力。你可以将其理解为一个提供“思考”服务的云端大脑,其他软件可以通过网络连接来使用它。

DeepSeek属于价格比较便宜的国产大模型

截至2026年,DeepSeek API主要提供基于 DeepSeek-V3.2 版本的两个核心模型:

-

deepseek-chat:这是标准对话模型。适用于大多数通用场景,包括日常对话、信息查询、文案撰写、代码生成等。它的特点是响应速度快,处理高效。

-

deepseek-reasoner:这是深度思考模型。它在回答问题前会先进行内部的推理过程(API返回结果中会包含思考链信息)。特别擅长处理需要复杂逻辑推理、数学计算、多步骤规划的任务。为OpenClaw调用此模式,可以让它执行更复杂的决策。

| 模型 | deepseek-chat | deepseek-reasoner | |

| BASE URL | https://api.deepseek.com | ||

| 模型版本 | DeepSeek-V3.2 (非思考模式) |

DeepSeek-V3.2 (思考模式) |

|

| 上下文长度 | 128K | ||

| 输出长度 | 默认 4K,最大 8K | 默认 32K,最大 64K | |

| 功能 | Json Output | 支持 | 支持 |

| Tool Calls | 支持 | 支持 | |

| 对话前缀续写(Beta) | 支持 | 支持 | |

| FIM 补全(Beta) | 支持 | 不支持 | |

| 价格 | 百万tokens输入(缓存命中) | 0.2元 | |

| 百万tokens输入(缓存未命中) | 2元 | ||

| 百万tokens输出 | 3元 | ||

DeepSeek API的设计充分考虑了易用性,尤其对初学者友好:

-

兼容性高:DeepSeek API采用了与行业通用标准(如OpenAI)兼容的格式。这意味着,如果OpenClaw本身支持接入OpenAI的API,通常只需简单修改两处配置——接口地址(base_url) 和 密钥(api_key)——即可切换为使用DeepSeek的服务。

-

接口地址(base_url):所有API请求都需要发送到这个统一的入口:

https://api.deepseek.com。为兼容性考虑,也可使用https://api.deepseek.com/v1。 -

开发者文档:在 DeepSeek API Docs 中,可以找到详细的接入指南、参数说明和各种编程语言(如Python、Node.js)的调用示例代码,是技术人员和集成者的主要操作手册。

-

开放平台控制台:DeepSeek Platform 是用户管理自己账户的核心区域。在这里,可以完成注册登录、创建和管理API Key(用于身份验证的密钥)、查看API调用次数、查询账户余额与费用明细等所有运营操作。

OpenClaw 模型选择完全指南:为什么国内用户首选 MiniMax?

By-MiniMax 2.5全能Agent

在 AI Agent 领域,2026年最火爆的开源项目当属 OpenClaw。这个由 PSPDFKit 创始人 Peter Steinberger 主导开发的开源自主式 AI Agent 执行引擎,自2026年1月正式发布以来,已在 GitHub 上斩获超过14万颗星,成为当之无愧的“王炸级”项目。

OpenClaw 的核心优势在于,它不仅仅是一个对话式 AI,而是一个能够“帮您干活”的智能助手。它可以直接在您的电脑上执行文件整理、代码部署、日程同步等任务,所有数据本地存储,隐私零泄露。

然而,要让 OpenClaw 发挥最大价值,选择合适的“大脑”——也就是大语言模型——至关重要。今天,我就来为大家详细分析,哪些模型最适合 OpenClaw,以及为什么国内用户一定要选择 MiniMax。

一、OpenClaw 支持的模型全景解析

OpenClaw 采用模型无关的设计理念,它不绑定任何特定厂商,而是作为一个灵活的智能调度中心,能够对接多种云端和本地的大模型。 根据社区实践和官方文档,OpenClaw 主要支持以下三类模型:

1.1 云端国际模型

国际模型包括 OpenAI 的 GPT 系列(如 GPT-4o)、Anthropic 的 Claude 系列以及 Google 的 Gemini 等。这些模型在复杂推理和创意任务方面表现优异,是处理高端工作的首选。

然而,对于国内用户而言,使用这些国际模型面临着一个巨大的痛点:网络问题。实测数据显示,直连这些海外 API 服务器,延迟可能高达1200毫秒,超时率超过8%。 这对于需要实时交互的 OpenClaw 来说,简直是灾难性的体验。

1.2 国内主流模型

为了适配中文语境和本地化需求,OpenClaw 深度集成了多款国产优质模型:

智谱 AI GLM-4.7:在中文语境下的指令遵循能力极强,且性价比较高,是目前国内用户部署 OpenClaw 的主流选择之一。

阿里通义千问(Qwen):通过 OAuth 认证可以实现一键配置,安装过程极为便捷。

月之暗面 Kimi K2.5:因其在编程和工具调用上的出色表现,成为 OpenClaw 上最流行的模型之一。

MiniMax 系列:作为中国“大模型六小龙”之一,MiniMax 凭借其强大的模型能力和极具竞争力的价格,正在成为越来越多用户的首选。

1.3 本地部署模型

如果您对数据隐私有更高要求,可以通过 Ollama 等工具在本地运行如 Llama 3、Qwen 等开源模型。这种方式适合处理敏感信息或执行简单的日常任务,实现“零 Token 成本”运行。

不过,本地部署对硬件要求较高。OpenClaw 官方建议使用至少 2 台满配 Mac Studio 或同等 GPU 配置(约 30000 美元以上)才能获得理想的运行效果。 对于普通用户来说,云端调用仍是更务实的选择。

二、MiniMax:OpenClaw 的最佳拍档

2.1 为什么选择 MiniMax?

在众多可选模型中,我强烈推荐国内用户选择 MiniMax,原因有以下几点:

首先,性能卓越。MiniMax M2.5 模型已在多项生产力基准测试中取得全球领先表现。在编程领域,该模型在 SWE-bench Verified 基准测试上创下行业新纪录,相较上一代 M2.1 效率提升 37%。 OpenClaw 创始人 Peter 曾公开表示,M2.1 是其偏好的最佳开源模型。

其次,性价比超高。以每秒 100 tokens 输出计,M2.5 运行复杂 Agent 每小时成本仅 1 美元。这意味着 1 万美元预算可以支撑 Agent 全年持续运行。 这样的成本优势,对于个人开发者和小型团队来说,简直是白菜价。

第三,国内访问无障碍。MiniMax 作为国内厂商,其 API 服务在国内访问延迟极低,稳定性远高于国际模型。

第四,生态完善。MiniMax 已与 OpenClaw 项目形成深度协同,推出了 MaxClaw,进一步降低用户使用门槛。

2.2 MiniMax 模型体系详解

MiniMax 构建了覆盖文本、视觉与音频的全模态模型体系:

文本大模型系列:

- M2.5:当前旗舰模型,面向 Agent 的通用推理底座,在编程和复杂任务处理方面表现卓越

- M2.1:开源的大规模推理模型,支持百万级 tokens 超长上下文

- Text-01:全新架构,性能比肩全球领军模型,超长上下文,极致性价比

视觉生成模型:

- Hailuo-02:视频生成模型的商业化应用标杆

- Hailuo-01/02:实现视频生成的突破性进展

音频模型:

- Speech-02:核心语音模型,超高相似度,超清音质

- Music 02/2.5:音乐生成模型

图像模型:

- MiniMax-Text-01:全新文生图模型,超低单价,人物写实,画面细腻如真

2.3 MiniMax API 能力一览

MiniMax 开放平台提供了丰富的 API 能力:

| API 类型 | 功能描述 |

|---|---|

| Chat Completions API | 对话式 AI 交互,适用于问答系统、客服机器人 |

| Realtime API | 实时对话能力 |

| T2A API | 语音合成,将文本转换为语音 |

| Video Generation API | 视频生成 |

| Image Generation API | 图像创作 |

| Music Generation API | 音乐生成 |

| Embeddings API | 文本嵌入,用于文本相似度分析、推荐系统 |

这些 API 全面覆盖了文本、语音、视频、音乐、图像等全模态能力,满足不同企业客户及开发者的需求。

三、minimaxi.com vs minimaxi.io:国内用户该如何选择?

这是很多用户困惑的问题。MiniMax 实际上有两个版本:minimaxi.com(国内版) 和 minimax.io(国际版)。虽然都是 MiniMax 的产品,但在多个方面存在显著差异:

3.1 价格对比

| 对比项 | minimaxi.com(国内版) | minimax.io(国际版) |

|---|---|---|

| 计价方式 | 按请求次数计费(Coding Plan) | 按 Token费 |

| 计支付方式 | 支付宝、微信、人民币 | 美元、国际信用卡 |

| 网络延迟 | 国内直连,延迟极低 | 需要翻墙,延迟较高 |

| 发票支持 | 支持国内增值税发票 | 不支持国内发票 |

3.2 套餐选择

国内版(Coding Plan) 最大的亮点是按请求次数计费,而非按 Token 计费。这对于部署 OpenClaw 的用户来说极为友好——您不需要担心每次对话消耗了多少 Token,只需要关注请求次数。

国际版 则采用传统的 Token 计费模式,虽然看似灵活,但对于高频使用的 Agent 场景,成本往往难以预测和控制。

3.3 推荐结论

强烈建议国内用户使用 minimaxi.com(国内版)。原因很简单:

四、MiniMax 国内版 Coding Plan:OpenClaw 用户的专属福利

4.1 什么是 Coding Plan?

2026年2月25日,阿里云百炼推出包含 Qwen3.5、GLM-5、MiniMax M2.5、Kimi K2.5 四款开源模型 API 服务的 Coding Plan(编程模型订阅服务)。

核心亮点:用户订阅套餐后不再受限于单一模型,可实现多模型自由切换。

4.2 套餐详情

| 套餐类型 | 请求次数 | 价格 | 适合场景 |

|---|---|---|---|

| Coding Plan Lite | 每月最多 1.8 万次 | 更低价格 | 个人开发、学习研究 |

| Coding Plan Pro | 每月最多 9 万次 | 优惠价格 | 专业开发、小团队 |

4.3 为什么 Coding Plan 特别适合 OpenClaw?

按请求次数计费是核心优势。不同于传统 API 按 Token 消耗计费的方式,Coding Plan 的请求次数计费模式对 OpenClaw 用户极为友好:

- 成本可预测:每月固定费用,无需担心突发流量导致账单爆炸

- 无需精细计算:不关心每次对话的 Token 消耗,只关心请求次数

- 适合高频场景:OpenClaw 作为您的数字员工,需要频繁交互,请求次数计费更划算

4.4 限时福利:共建邀请计划

MiniMax 国内版推出了** Coding Plan 跨年福利-共建邀请计划**:

- 活动时间:截止到 2026年4月30日

- 优惠内容:受邀者通过共建者专属邀请码订阅 Coding Plan,享 9折优惠

- 身份权益:并获得 Builder 身份

专属邀请码:8u1ReriYHG

立即参与:https://platform.minimaxi.com/subscribe/coding-plan?code=8u1ReriYHG&source=link

这个价格,这个功能,对于想要部署 OpenClaw 的国内用户来说,简直是千载难逢的机会!

五、总结与建议

5.1 模型选择建议

| 用户类型 | 推荐模型 | 推荐理由 |

|---|---|---|

| 国内个人用户 | MiniMax M2.5(Coding Plan) | 性价比高、国内访问无障碍、按请求计费 |

| 国内企业用户 | MiniMax M2.5 + API 套餐 | 稳定可靠、支持大规模调用 |

| 高隐私需求 | Ollama + 本地 Qwen | 数据完全本地化 |

| 预算有限 | 智谱 GLM-4.7 | 价格实惠、中文表现好 |

5.2 行动建议

8u1ReriYHG 订阅 Coding Plan,享9折优惠

暂无评论内容